Trí tuệ nhân tạo không chỉ mang lại hiệu suất ấn tượng mà còn tạo ra nhu cầu năng lượng đáng kể. Những nhiệm vụ được đào tạo càng đòi hỏi khắt khe thì nó càng tiêu tốn nhiều năng lượng hơn.

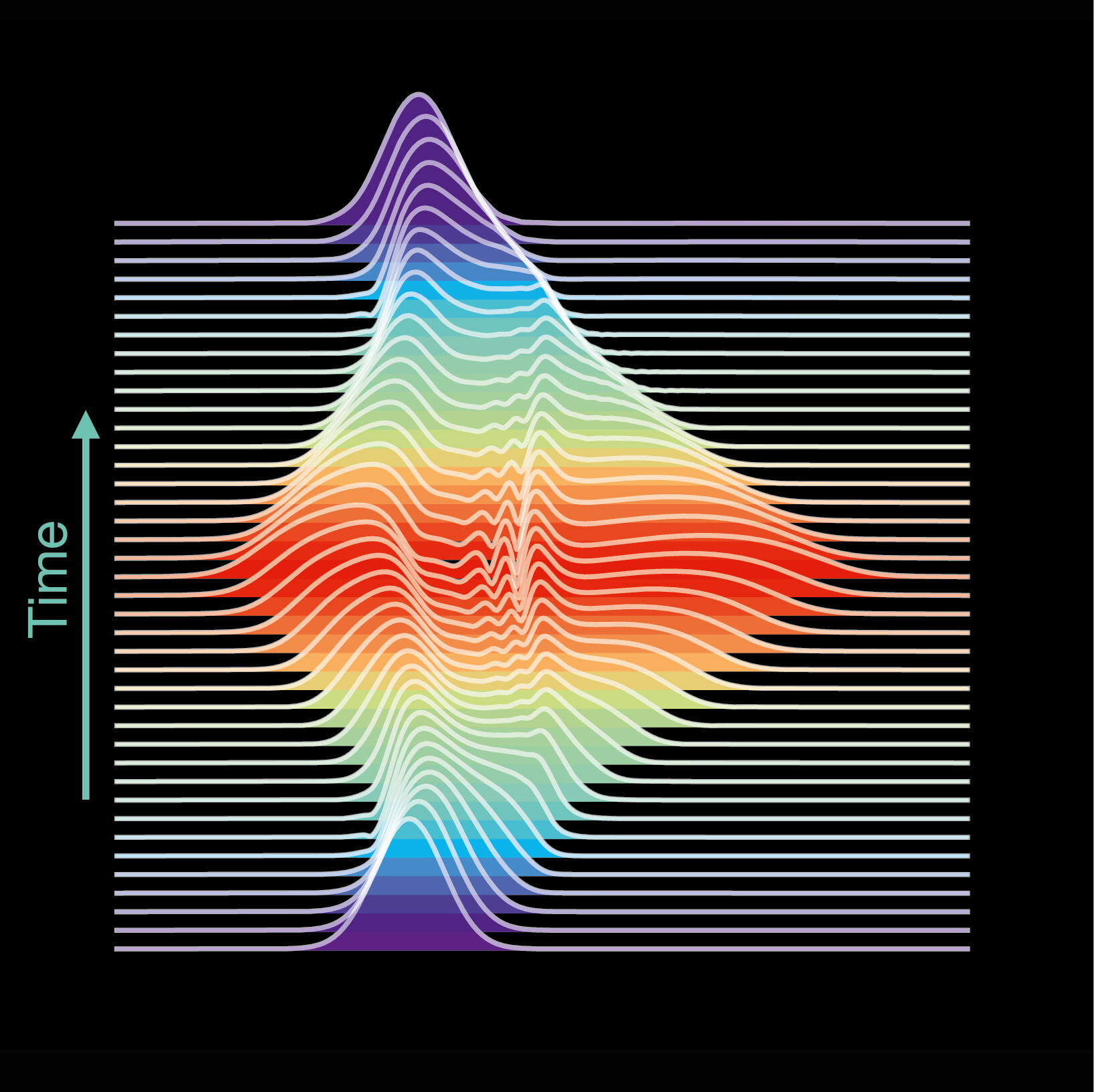

Học bằng ánh sáng: Đây chính là động lực học của sóng ánh sáng được sử dụng bên trong một cỗ máy tự học vật lý. Điều quan trọng là hình dạng bất thường của nó và sự phát triển của nó bị đảo ngược hoàn toàn so với thời điểm nó phát triển nhất (màu đỏ). Nhà cung cấp hình ảnh: Florian Marquardt, MPL

Víctor López-Pastor và Florian Marquardt, hai nhà khoa học tại Viện Khoa học Ánh sáng Max Planck ở Erlangen, Đức, trình bày một phương pháp mà trí tuệ nhân tạo có thể được đào tạo hiệu quả hơn nhiều. Cách tiếp cận của họ dựa vào các quy trình vật lý thay vì mạng lưới thần kinh nhân tạo kỹ thuật số hiện đang được sử dụng. Công trình được công bố trên tạp chí Physical Review X.

Lượng năng lượng cần thiết để đào tạo GPT-3, điều giúp ChatGPT trở thành Chatbot hùng hồn và rõ ràng là có đầy đủ thông tin, vẫn chưa được Open AI, công ty đứng sau trí tuệ nhân tạo (AI) đó tiết lộ. Theo công ty thống kê Statista của Đức, điều này sẽ cần 1.000 megawatt giờ - tương đương với khoảng 200 hộ gia đình Đức có từ ba người trở lên tiêu thụ hàng năm. Mặc dù mức tiêu hao năng lượng này đã cho phép GPT-3 tìm hiểu xem từ "sâu" có nhiều khả năng được theo sau bởi từ "biển" hay "học" trong tập dữ liệu của mình hay không, nhưng theo tất cả các tài khoản, GPT-3 vẫn chưa hiểu ý nghĩa cơ bản của điều đó. cụm từ.

Mạng lưới thần kinh trên máy tính mô phỏng thần kinh

Để giảm mức tiêu thụ năng lượng của máy tính và đặc biệt là các ứng dụng AI, trong vài năm qua, một số tổ chức nghiên cứu đã nghiên cứu một khái niệm hoàn toàn mới về cách máy tính có thể xử lý dữ liệu trong tương lai. Khái niệm này được gọi là điện toán mô phỏng thần kinh. Mặc dù điều này nghe có vẻ giống với mạng nơ-ron nhân tạo nhưng trên thực tế nó không liên quan nhiều đến chúng vì mạng nơ-ron nhân tạo chạy trên các máy tính kỹ thuật số thông thường.

Điều này có nghĩa là phần mềm, hay chính xác hơn là thuật toán, được mô hình hóa theo cách hoạt động của bộ não, nhưng máy tính kỹ thuật số đóng vai trò là phần cứng. Chúng thực hiện tuần tự các bước tính toán của mạng nơ-ron, phân biệt giữa bộ xử lý và bộ nhớ.

Marquardt, giám đốc Viện Khoa học Max Planck cho biết: “Chỉ riêng việc truyền dữ liệu giữa hai thành phần này đã tiêu tốn một lượng lớn năng lượng khi mạng lưới thần kinh huấn luyện hàng trăm tỷ tham số, tức là các khớp thần kinh, với tối đa một terabyte dữ liệu”. của Light và giáo sư tại Đại học Erlangen.

Bộ não con người hoàn toàn khác và có lẽ sẽ không bao giờ có khả năng cạnh tranh về mặt tiến hóa nếu nó hoạt động với hiệu suất năng lượng tương tự như máy tính có bóng bán dẫn silicon. Rất có thể nó đã thất bại do quá nóng.

Bộ não có đặc điểm là thực hiện nhiều bước của quá trình suy nghĩ song song chứ không tuần tự. Các tế bào thần kinh, hay chính xác hơn là các khớp thần kinh, vừa là bộ xử lý vừa là bộ nhớ. Nhiều hệ thống khác nhau trên khắp thế giới đang được coi là ứng cử viên tiềm năng cho các đối tác hình thái thần kinh đối với các tế bào thần kinh của chúng ta, bao gồm các mạch quang tử sử dụng ánh sáng thay vì điện tử để thực hiện các phép tính. Các thành phần của chúng phục vụ đồng thời như các công tắc và ô nhớ.

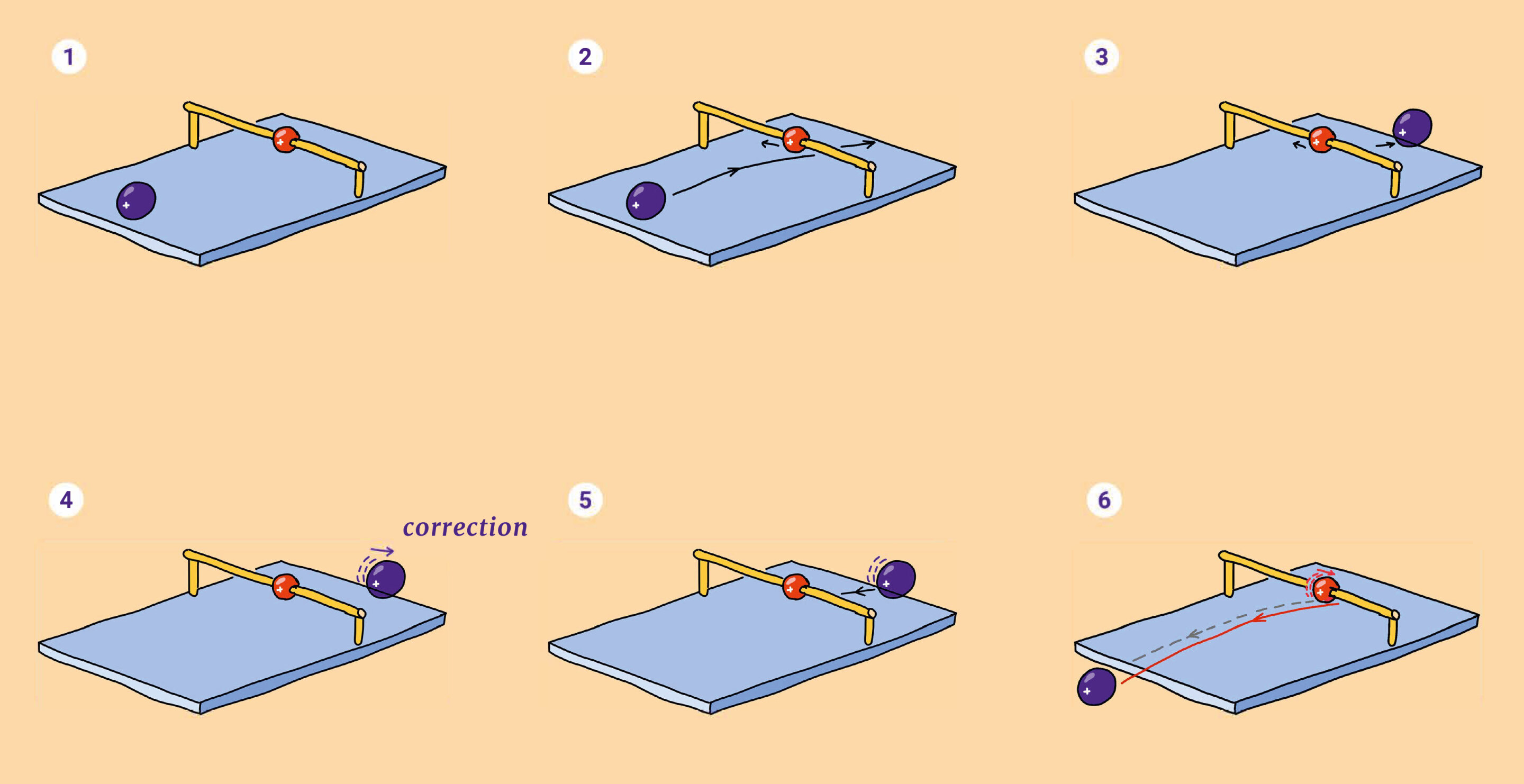

Trí tuệ nhân tạo là sự kết hợp giữa pinball và bàn tính: Trong thí nghiệm tưởng tượng này, pinball tích điện dương màu xanh tượng trưng cho một tập hợp dữ liệu huấn luyện. Quả bóng được phóng từ mặt này sang mặt kia của đĩa. Nhà cung cấp hình ảnh: Florian Marquardt, MPL

Một cỗ máy vật lý tự học tối ưu hóa các khớp thần kinh của nó một cách độc lập

Cùng với López-Pastor, một nghiên cứu sinh tiến sĩ tại Viện Khoa học Ánh sáng Max Planck, Marquardt hiện đã nghĩ ra một phương pháp đào tạo hiệu quả cho các máy tính mô phỏng thần kinh. Florian Marquardt giải thích: “Chúng tôi đã phát triển khái niệm về một cỗ máy vật lý tự học”. "Ý tưởng cốt lõi là thực hiện việc đào tạo dưới dạng một quy trình vật lý, trong đó các thông số của máy được tối ưu hóa bởi chính quy trình đó."

Khi đào tạo mạng lưới thần kinh nhân tạo thông thường, phản hồi bên ngoài là cần thiết để điều chỉnh sức mạnh của hàng tỷ kết nối khớp thần kinh. Marquardt cho biết: “Việc không yêu cầu phản hồi này sẽ khiến việc đào tạo trở nên hiệu quả hơn nhiều”. Việc triển khai và đào tạo trí tuệ nhân tạo trên máy vật lý tự học sẽ không chỉ tiết kiệm năng lượng mà còn tiết kiệm thời gian tính toán.

Marquardt giải thích: “Phương pháp của chúng tôi hoạt động bất kể quy trình vật lý nào diễn ra trong máy tự học và chúng tôi thậm chí không cần biết quy trình chính xác”. "Tuy nhiên, quá trình này phải đáp ứng một số điều kiện. Quan trọng nhất là nó phải có khả năng đảo ngược, nghĩa là nó phải có khả năng chạy tiến hoặc lùi với mức tổn thất năng lượng ở mức tối thiểu."

Marquardt nói: “Ngoài ra, quá trình vật lý phải phi tuyến tính, nghĩa là đủ phức tạp”. Chỉ các quy trình phi tuyến tính mới có thể thực hiện được các phép biến đổi phức tạp giữa dữ liệu đầu vào và kết quả. Một quả bóng lăn lăn trên một tấm mà không va chạm với một tấm khác là một hành động tuyến tính. Tuy nhiên, nếu nó bị người khác làm phiền, tình hình sẽ trở nên phi tuyến tính.

Thử nghiệm thực hành trên máy tính mô phỏng thần kinh quang học

Ví dụ về các quá trình phi tuyến tính thuận nghịch có thể được tìm thấy trong quang học. Thật vậy, López-Pastor và Marquardt đã hợp tác với một nhóm thử nghiệm đang phát triển một máy tính biến đổi thần kinh quang học. Máy này xử lý thông tin dưới dạng sóng ánh sáng chồng lên nhau, nhờ đó các thành phần phù hợp sẽ điều chỉnh loại và cường độ tương tác. Mục đích của các nhà nghiên cứu là đưa khái niệm về cỗ máy vật lý tự học vào thực tế.

Florian Marquardt nói: “Chúng tôi hy vọng có thể giới thiệu cỗ máy vật lý tự học đầu tiên sau ba năm nữa”. Đến lúc đó, sẽ có những mạng lưới thần kinh suy nghĩ với nhiều khớp thần kinh hơn và được đào tạo với lượng dữ liệu lớn hơn đáng kể so với ngày nay.

Kết quả là có thể sẽ có mong muốn lớn hơn nữa là triển khai các mạng lưới thần kinh bên ngoài các máy tính kỹ thuật số thông thường và thay thế chúng bằng các máy tính biến đổi thần kinh được đào tạo hiệu quả. Nhà vật lý cho biết: “Do đó, chúng tôi tin tưởng rằng các máy vật lý tự học có cơ hội lớn được sử dụng để phát triển hơn nữa trí tuệ nhân tạo”.